La inteligencia artificial (IA) está cada vez más presente en nuestras vidas. Desde aplicaciones como ChatGPT hasta sistemas que gestionan el tránsito, hacen diagnósticos médicos o seleccionan los contenidos que consumimos en redes, su avance parece imparable. Pero cuando hablamos de IA, ¿sabemos realmente de qué hablamos?

Muchas veces, el concepto resulta tan amplio que cuesta abordarlo. Circulan discursos catastróficos —“la IA es el fin del mundo”— y otros cargados de esperanza —“la IA va a solucionarlo todo”—. Paradójicamente, solemos creer ambas cosas al mismo tiempo.

En medio de estas tensiones, la pregunta se vuelve urgente:

¿La IA avanza más rápido de lo que podemos regular? ¿Y quién la controla?

Tres voces argentinas para pensar la inteligencia artificial

Para intentar responder a estas preguntas, Infobae reunió a tres especialistas argentinos que trabajan activamente con esta tecnología:

- Santiago Siri, emprendedor y activista enfocado en democracia digital y blockchain

- Julia Pomares, politóloga y exdirectora de CIPPEC

- Tomás Balmaceda, doctor en Filosofía, investigador del CONICET y divulgador sobre ética y tecnología

La conversación, moderada por el periodista Gonzalo Sánchez, forma parte del ciclo audiovisual La Conversación, disponible en YouTube. En este episodio, la pregunta es concreta:

¿Quién controla la inteligencia artificial?

⏩ El vértigo del avance

Uno de los primeros dilemas planteados fue si la IA se está desarrollando a una velocidad que supera nuestra capacidad de regularla. Pomares no duda: “La IA avanza más rápido de lo que podemos regular”. Balmaceda, con un enfoque más esperanzado, cree que todavía hay margen para hacerlo, pero advierte que el poder está concentrado en muy pocas manos.

Siri lo describe con crudeza: “Para entrenar un modelo como ChatGPT necesitás todo internet, miles de placas gráficas y millones de dólares”. Esos recursos están al alcance de muy pocos actores, principalmente grandes corporaciones tecnológicas. Y los Estados, muchas veces debilitados, corren detrás.

🧠 Una caja negra difícil de abrir

Otro punto crítico es la falta de transparencia. Siri y Balmaceda coinciden en que muchas veces ni siquiera los desarrolladores saben con exactitud qué ocurre dentro de una red neuronal. Esto vuelve aún más difícil establecer regulaciones claras o garantizar un uso ético de la IA.

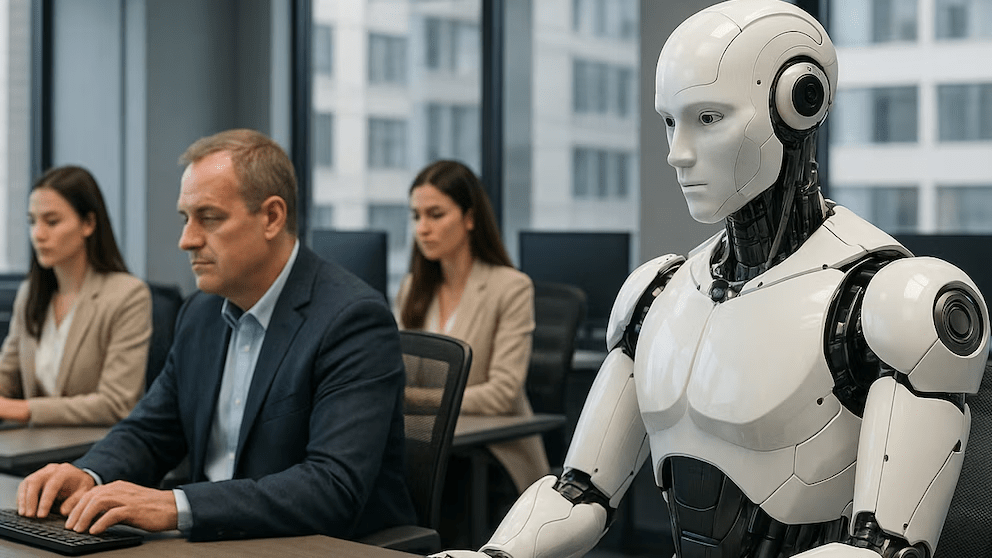

👩💻 ¿Nos va a reemplazar?

“La IA no te va a reemplazar, te va a reemplazar alguien que sepa usar IA”, afirma Siri. Pero el debate va más allá del empleo: ¿Qué ocurre si esta tecnología empieza a ocupar también los espacios más creativos, los que más disfrutamos?

Pomares advierte que la IA no solo automatiza lo repetitivo, sino que también puede vaciar de sentido ciertos trabajos: “Si te arrebata lo más interesante de tu tarea, lo que queda puede ser una experiencia empobrecida”.

Aunque las tecnologías han aumentado la productividad global, el efecto en la desigualdad es claro: “Los ricos son más ricos y los pobres más pobres”, resume. Balmaceda también pone el foco en otro aspecto: el valor de la eficiencia. “Lo que sucede en un aula no puede medirse solo en términos de productividad. Enseñar es otra cosa”, dice.

📚 Pensar como forma de resistencia

Uno de los momentos más profundos de la charla se centró en la educación. Balmaceda defendió la idea de que escribir es pensar. Y que delegar ese proceso en una IA no solo atenta contra el aprendizaje, sino que debilita la capacidad de razonar críticamente.

¿Qué pasa si una generación entera deja de leer, escribir y analizar por cuenta propia?

Un estudio del MIT, citado en el encuentro, mostró que quienes toman decisiones asistidos por IA activan menos recursos cerebrales. Siri, sin embargo, propone otra lectura: “Quizás eso nos libere espacio mental para hacer más cosas”.

La clave parece estar en el equilibrio.

⚖️ Una tecnología profundamente política

Hacia el final, los tres especialistas coincidieron en que la IA no es neutral. Los algoritmos que rigen nuestras redes sociales, que deciden qué vemos o qué consumimos, moldean nuestro acceso al mundo.

“El desafío ya no es solo técnico”, concluyó Pomares. Es político: decidir cómo queremos que funcione esta tecnología, qué sociedad queremos construir con ella y qué valores vamos a defender para que la IA siga estando a nuestro servicio, y no al revés.